你以为AI只是工具?它也可能成为骗子的“帮凶”。随着人工智能技术的飞速发展,AI技术已深入日常生活。然而,这些本应便利人类的技,正被不法分子恶意利用,成为新型诈骗的方式。

案例分析

案例一

2025年8月,杭州某高校大三学生小孙在宿舍上网时,接到“老师”打来的QQ语音电话。

对方声音和老师毫无二致,说正在参与一个重要科研项目的申报,有笔5000元的加急资料费需要马上缴纳,因自己在外面办事无法操作,让小孙帮忙先转一下,回头就还给他。小孙本有些犹豫,但随后“老师”又通过QQ发来了项目相关文件,看着文件上熟悉的学校抬头和项目名称,小孙打消了疑虑,立即向“老师”提供的账户转了钱。

可等他之后和老师提及此事,才发现老师根本没让他帮忙转账,自己遭遇了AI语音合成与资料伪造结合的诈骗。

案例二

2025年3月,成都的大学生小王在图书馆学习时,收到“学长”的QQ视频通话。“学长”称自己创业遇到资金周转难题,急需3000元救急,承诺一周内归还。小王看视频里确实是熟悉的学长,便转账帮忙,结果被骗。后来才知道,学长的账号被盗,诈骗分子利用AI换脸技术伪装行骗 。

技术揭秘

警方调查发现,骗子使用了AI深度伪造技术(Deepfake):

通过社交平台公开的辅导员照片和讲课视频,生成逼真的换脸视频。

利用AI语音克隆技术,模仿其声线和语调。

搭建高仿真的钓鱼网站,伪装成学校官网。

整个过程高度仿真,普通学生几乎无法分辨真伪。

常见套路

1.冒充熟人/老师/家长

利用AI换脸+语音合成,伪装成你信任的人进行视频或语音通话,要求转账或提供验证码。

2.AI客服”诱导贷款

假冒银行、电商平台客服,声称“账户异常”“征信修复”,引导下载虚假APP并申请网贷。

3.AI生成虚假招聘信息

在社交平台发布高薪兼职,用AI聊天机器人自动回复,骗取押金、培训费或身份证信息。

4.情感诈骗(AI“恋人”)

通过交友软件建立感情,用AI生成照片、语音维持关系,最终以“生病”“投资”为由索要钱财。

如何防范AI诈骗

凡涉及转账,必须当面或电话二次确认

即使对方视频通话再真实,也务必通过另一个已知联系方式(如官方电话、微信语音)核实身份。

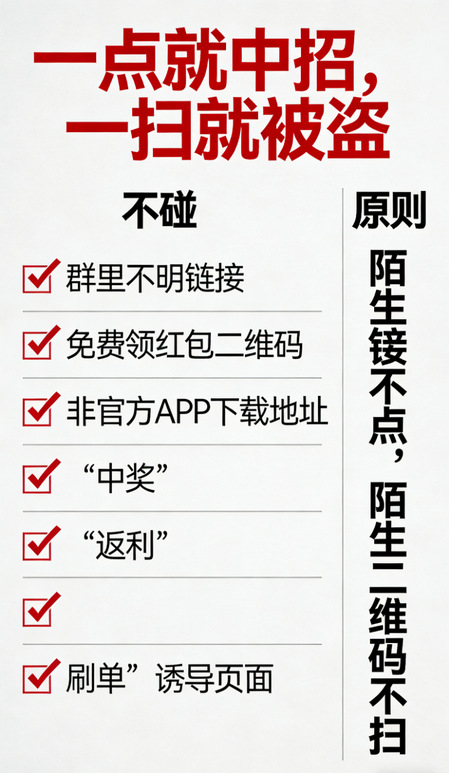

不点陌生链接,不下载不明APP

所有“系统验证”“资金解冻”都是借口,正规机构绝不会让你转账“验资”。

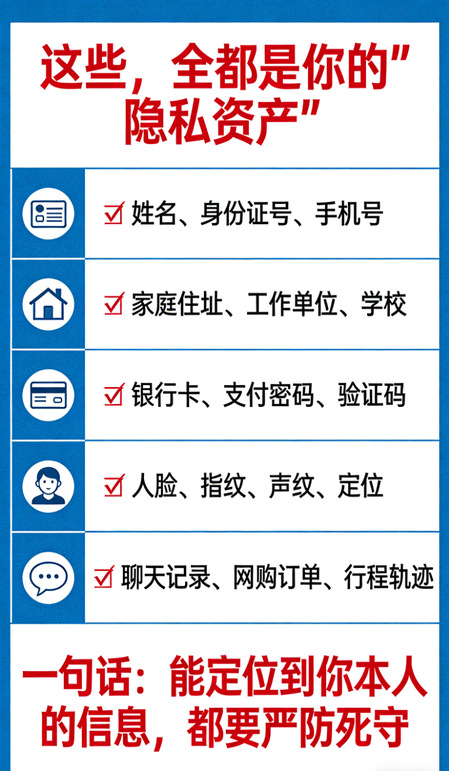

保护个人社交信息

避免在朋友圈、抖音等平台过度曝光照片、视频、语音,这些都可能被用于AI训练。

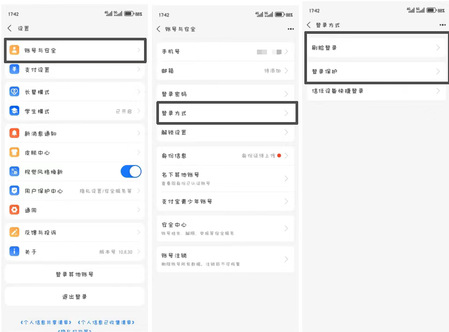

开启多重验证(2FA)

为微信、支付宝、银行卡等重要账户开启人脸识别+短信双重验证。

及时报警并保留证据

一旦发现被骗,立即拨打110,并保存聊天记录、转账截图、对方账号等信息。

保卫处提示

AI不是洪水猛兽,但它的滥用正在让诈骗变得更加隐蔽和危险。作为数字原住民的大学生,既要拥抱技术,更要保持清醒。再逼真的AI,也抵不过一次真实的确认。